1. 하드웨어 점검 (Physical Layer)

소프트웨어 설정을 하기 전, 물리적인 연결이 정상인지 확인하는 것이 첫 번째입니다.

- 전원(Power): 센서가 요구하는 전압(AVDD, DVDD, IOVDD)이 데이터시트 기준에 맞게 공급되는지 확인합니다.

- 클록(MCLK): 센서의 메인 클록 신호가 정상적으로 입력되는지 체크합니다.

- 리셋 및 파워다운(Reset/PWDN): 제어 핀의 논리 레벨(High/Low)이 드라이버 상에서 반대로 설정되지 않았는지 확인합니다.

2. 제어 인터페이스 확인 (I2C Communication)

카메라 센서의 레지스터를 설정하기 위해 I2C 통신이 먼저 성공해야 합니다.

- Slave Address: 센서의 I2C 주소가 맞는지 확인합니다.

- Chip ID Read: 드라이버 로드 시 가장 먼저 수행하는 작업입니다. 센서 내부의 고유 ID 레지스터를 읽어 통신이 정상임을 확신할 수 있습니다. 만약 여기서 실패한다면 전원이나 I2C 라인의 풀업(Pull-up) 저항 등을 의심해야 합니다.

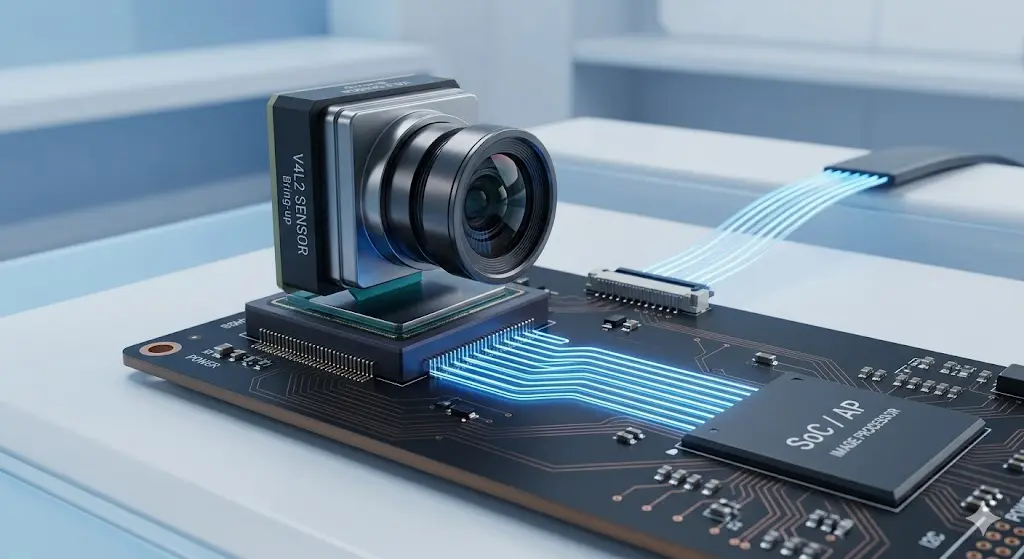

3. 데이터 전송 인터페이스 설정 (MIPI CSI-2 / DVP)

이미지 데이터를 전송하기 위한 통로를 설정합니다. 요즘은 대부분 MIPI CSI-2 인터페이스를 사용합니다.

- Lane 설정: 데이터 레인(Lane)의 개수(1, 2, 4 lane 등)를 맞춥니다.

- D-PHY/C-PHY: 인터페이스 물리 계층 규격을 일치시킵니다.

- Pixel Format: RAW8, RAW10, RAW12, YUV422 등 전송 포맷을 정의합니다.

4. 커널 드라이버 및 DTB 설정 (Software Layer)

리눅스 환경이라면 Device Tree(DTS)와 V4L2(Video for Linux 2) 프레임워크를 이해해야 합니다.

- Device Tree: 센서의 I2C 주소, 클록 주파수, GPIO 핀, 포트 노드(MIPI 연결 정보)를 기술합니다.

- Sensor Driver: V4L2 서브디바이스로 등록되며, 센서 초기화 시퀀스(Register Setting)를 포함합니다.

- Host Controller Driver: AP(Application Processor) 측의 MIPI 수신기 및 ISP(Image Signal Processor) 드라이버입니다.

5. 센서 설정 및 초기화 시퀀스 (Initialization)

센서 제조사에서 제공하는 레지스터 설정값(Setting Sheet)을 드라이버에 반영합니다.

- Resolution & FPS: 해상도와 프레임 레이트를 결정합니다.

- Exposure & Gain: 초기 노출값과 게인값을 설정합니다.

- Test Pattern: 데이터 라인 전송에 문제가 없는지 확인하기 위해 센서 자체에서 제공하는 컬러바(Color Bar) 패턴을 먼저 띄워보는 것이 좋습니다.

6. 영상 파이프라인 구성 (V4L2 Framework)

하드웨어 연결이 끝났다면 소프트웨어에서 데이터를 받아올 준비를 합니다.

- Media Controller: 센서 -> MIPI Rx -> ISP -> Memory로 이어지는 파이프라인을 링크(Link)합니다.

- V4L2-CTL: 커맨드라인 도구를 사용하여 스트리밍을 시작해 봅니다.

# 예시 명령: 프레임 캡처 테스트 v4l2-ctl --device /dev/video0 --stream-mmap --stream-count=1 --stream-to=test.raw

7. 이미지 튜닝 및 출력 (ISP Tuning)

영상이 화면에 나오더라도 색감이 이상하거나 노이즈가 많을 수 있습니다. 이때 ISP 튜닝이 필요합니다.

- Black Level Correction (BLC)

- Lens Shading Correction (LSC)

- White Balance (AWB) & Auto Exposure (AE)

- Demosaicing: RAW 데이터를 RGB/YUV로 변환합니다.

]]>